1. 概述编辑

本文将介绍如何部署 FineChatBI 。

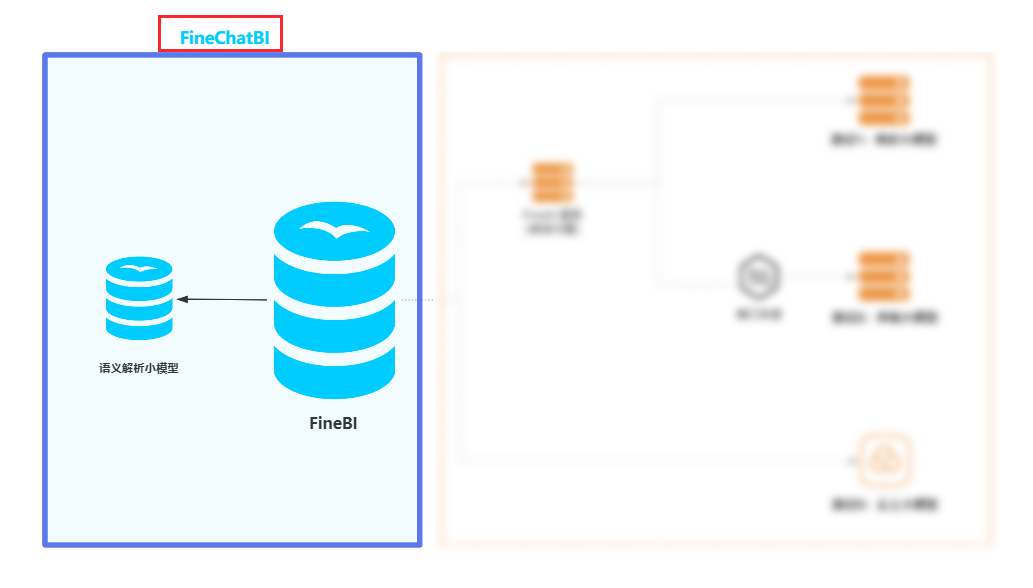

1)FineChatBI 以 FineBI 为底座进行分析,所以需要先准备一台 FineBI 工程。

2)部署语义解析小模型:用户提出的问题通过语义解析小模型转化成可执行的数据查询语句,是 FineChatBI 功能的核心。

3)安装问答 FineChatBI 插件。

2. 环境要求编辑

2.1 FineBI 环境说明

2.1.1 依赖版本说明

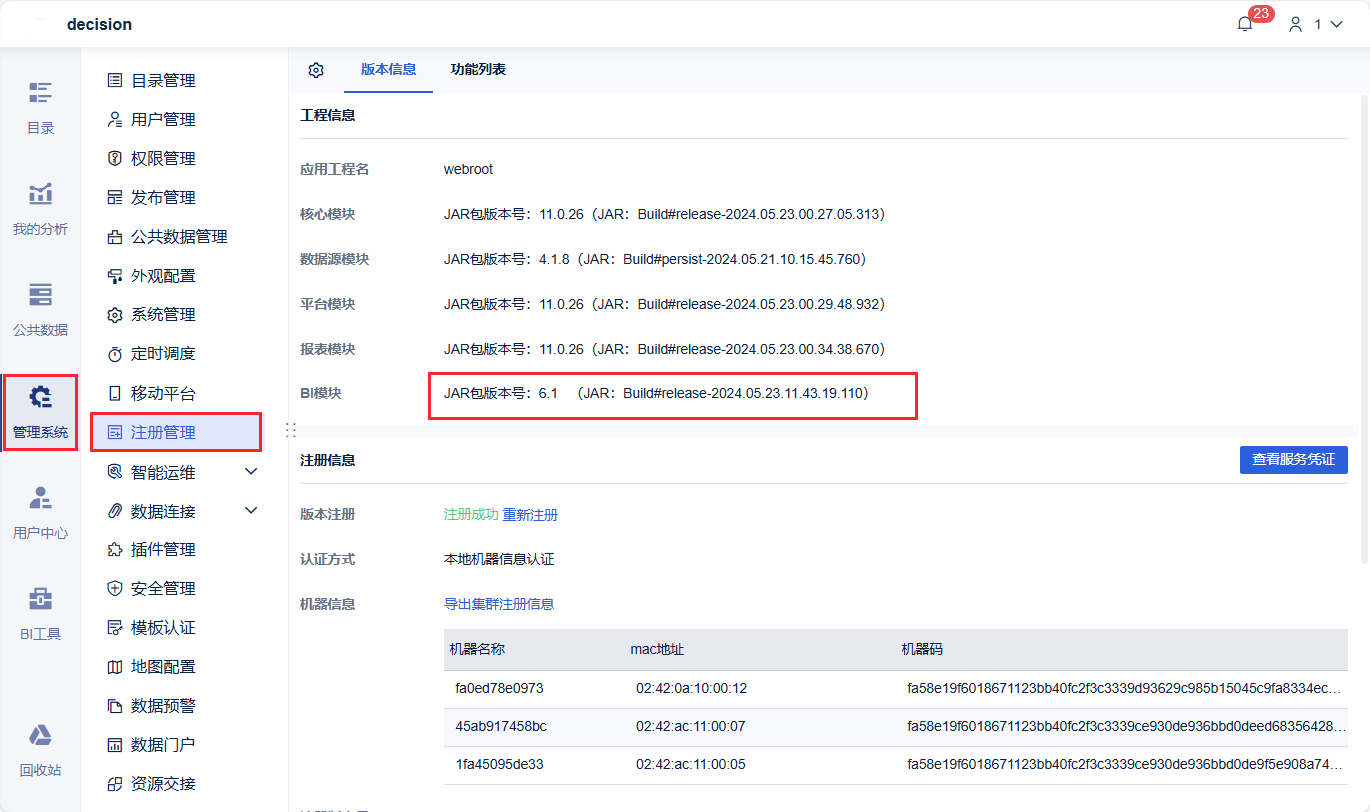

FineChatAI 需依赖 FineBI6.1 及以上版本,需确保服务器中已部署 BI 6.1及以上版本的工程。

未部署 FineBI 的用户:需全新部署 FineBI 6.1+ 版本,请参见本文 2.1.2

已部署 FineBI 的用户:进入「管理系统>注册管理>版本信息」检查版本号,若版本低于 6.1,需先升级至 6.1 及以上版本。

2.1.2 资源配置规则

FineBI 所在的服务器需要为 FineChatAI 的使用预留资源。

计算规则:

将 FineChatAI 的用户算作 FineBI 的编辑用户计算服务器所需资源

额外预留 10% 的服务器资源用于 FineChatAI 的使用

未部署 FineBI 的用户依据以上计算规则,参考 确认FineBI项目服务器配置 的服务器选型标准和部署指导进行部署。

已经部署 FineBI 的用户也需依据以上计算规则,衡量已有服务器是否需要增加资源。

2.2 语义解析小模型环境要求

BI规则模型和 BI 工程建议分布部署在两台服务器上,若需要部署在同一台服务器上请注意预留出足够的空间。

BI 规则模型部署环境要求如下表所示:

| 配置项 | 最低配置 | 推荐配置 |

|---|---|---|

| Linux 内核版本 | 3.10以上 | 3.10以上 |

| 位数 | 64位 | 64位 |

| 核数 | 8核 | 16核 |

| 内存 | 16G | 32G |

| 硬盘 | 80G | 100G |

| Docker | 20.0.0 | 20.0.0及以上 |

3. 部署语义解析小模型编辑

获取语义解析小模型的部署资源:

| 资源 | 获取渠道 |

|---|---|

| 镜像文件 | 下载镜像文件 |

| 代码包 | 联系运营获取 |

| FineChatBI 插件 | 联系运营获取 |

3.1 安装 Docker

安装步骤中需要使用到 Docker,请先检查服务器中是否已完成安装 Docker,检查 Docker 命令:docker --version

若没有安装则会显示 command not found,如下图所示,此时则需要在服务器上安装 Docker,安装步骤可参考:Linux系统在线安装Docker

![]()

若已安装则会显示 Docker 的版本信息,如下图所示:

![]()

3.2 安装镜像

0)(可选)镜像文件完整性校验

安装镜像过程失败时,可查看镜像文件 md5 码和本文档是否一致,若不一致则需要重新下载文件。

示例代码:md5sum fine-chat-bi-parser-base_v1_6.tar

| 镜像文件名 | md5 校验码 |

|---|---|

| fine-chat-bi-parser-base_v1_6.tar | a4b82e5ea243fa7acd9aa6771eb55810 |

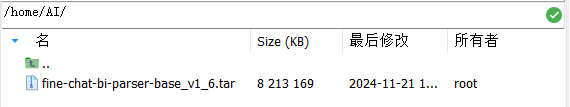

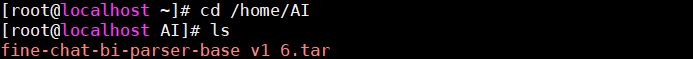

1)将 「镜像」上传到服务器中指定的文件夹中

示例上传文件夹路径为:/home/AI

注:直接上传,上传后不要解压!!!

2)使用命令进入到文件夹路径,命令为:cd 文件夹路径

示例代码:cd /home/AI

3)检查文件

示例代码:ls

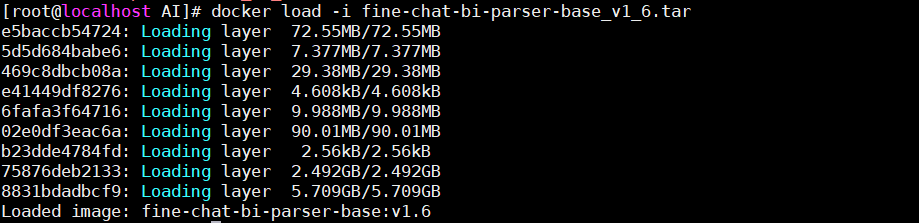

4)运行镜像文件,命令为:docker load -i 镜像文件压缩包

示例代码:docker load -i fine-chat-bi-parser-base_v1_6.tar

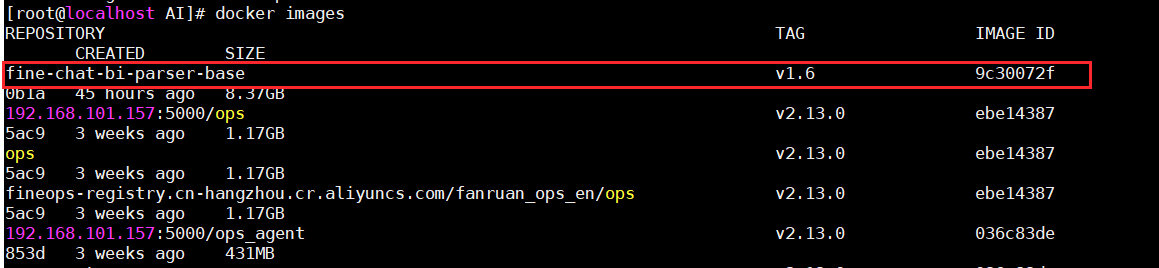

5)运行完成后,使用命令检查,出现镜像的名称和版本号即为完成,命令为:docker images

示例代码:docker images

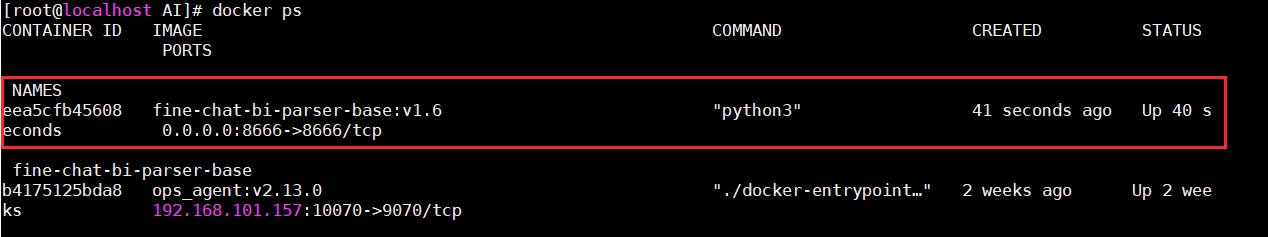

6)使用命令运行镜像,命令为:docker run -it -e TZ=Asia/Shanghai --name fine-chat-bi-parser-base -d -p 8666:8666 基础镜像名称:基础镜像版本号

示例代码:docker run -it -e TZ=Asia/Shanghai --name fine-chat-bi-parser-base -d -p 8666:8666 fine-chat-bi-parser-base:v1.6

![]()

7)使用命令检查容器,命令为:docker ps

3.3 安装代码

1)将获取的代码文件 encrypt_vXX_XXX.tar 包上传至服务器,之后再解压。命令为:tar -xvf 代码文件路径/代码文件名称

示例代码:tar -xvf /home/AI/encrypt_v1_5_1.tar

2)将代码文件放置到镜像中,命令为:docker cp 代码文件路径/代码文件名称 fine-chat-bi-parser-base:/root/

示例代码:docker cp /home/AI/encrypt_v1_5_1/ fine-chat-bi-parser-base:/root/

3)进入镜像的 /bin/bash 文件夹中,命令为:docker exec -it 镜像名称 /bin/bash

示例代码:docker exec -it fine-chat-bi-parser-base /bin/bash

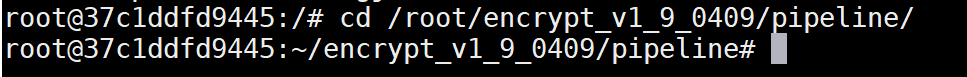

4)进入代码文件夹,命令为:cd /root/代码文件名称/pipeline/

示例代码:cd /root/encrypt_v1_5_1/pipeline/

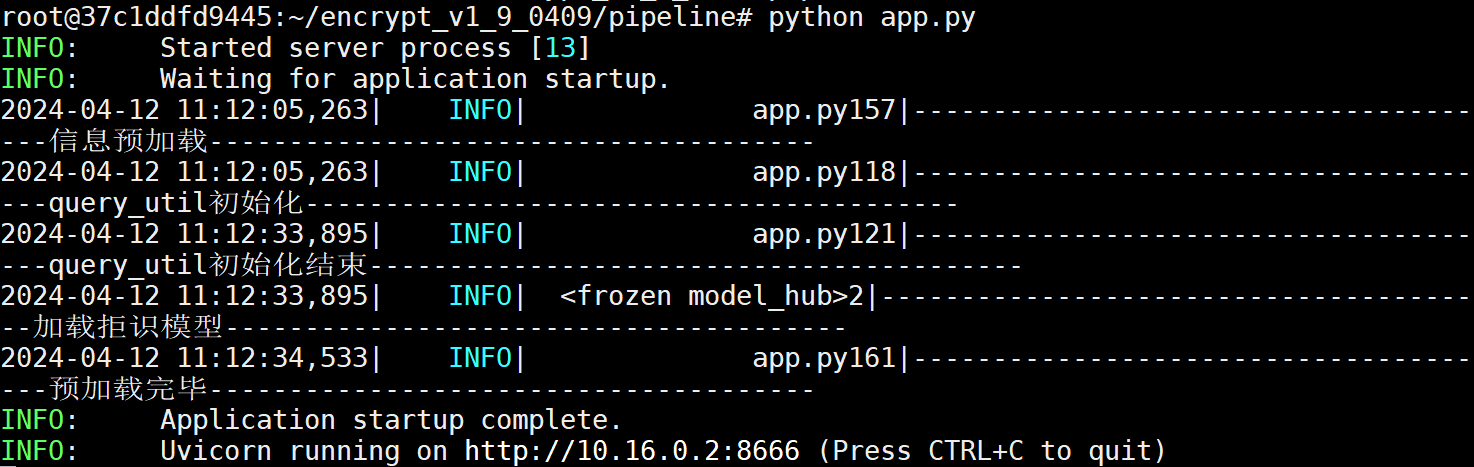

5)运行代码,命令为:python app.py

示例代码:python app.py

6)可直接关闭终端,或依次按下 Ctrl+P 和 Ctrl+Q 退出 Docker 容器。

4. 安装问答 BI 插件编辑

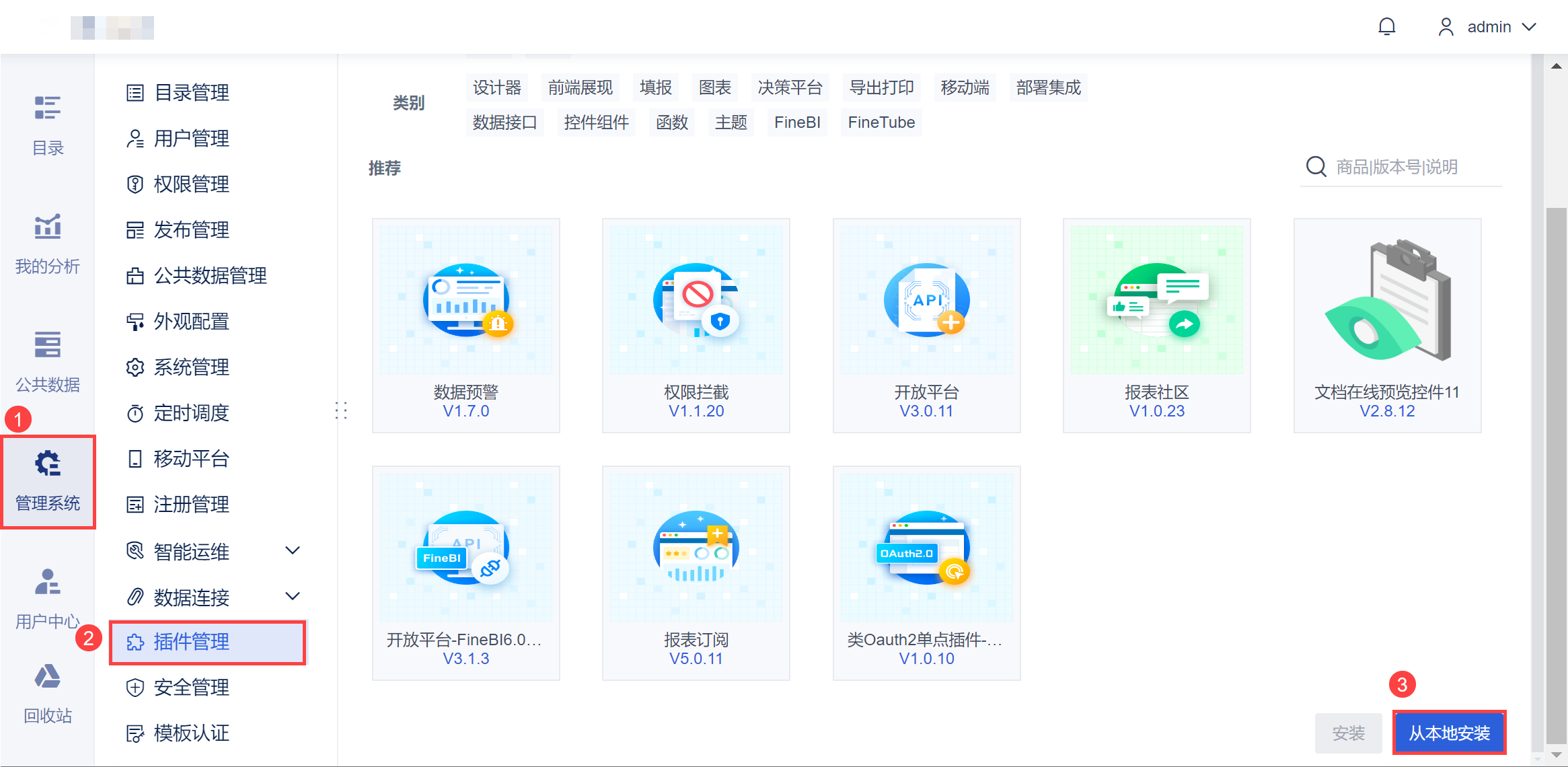

1)超管登录管理平台,选择「管理系统>插件管理>应用商城」,选择从本地安装获取的安装包,完成安装即可。

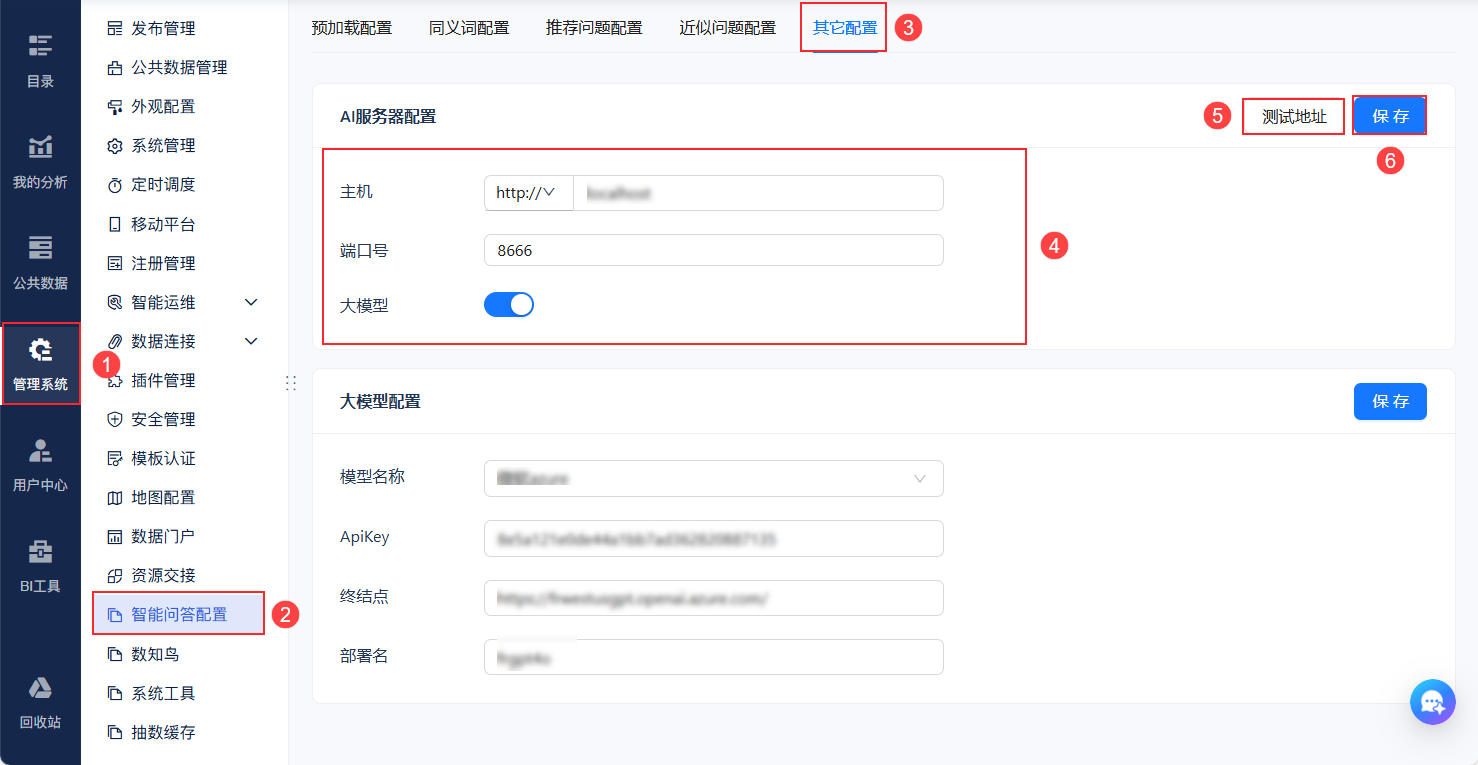

2)完成后刷新页面,选择「管理系统>智能问答配置」,配置 规则模型的 ip 地址和端口号(默认端口为8666),测试成功后,点击保存即可。

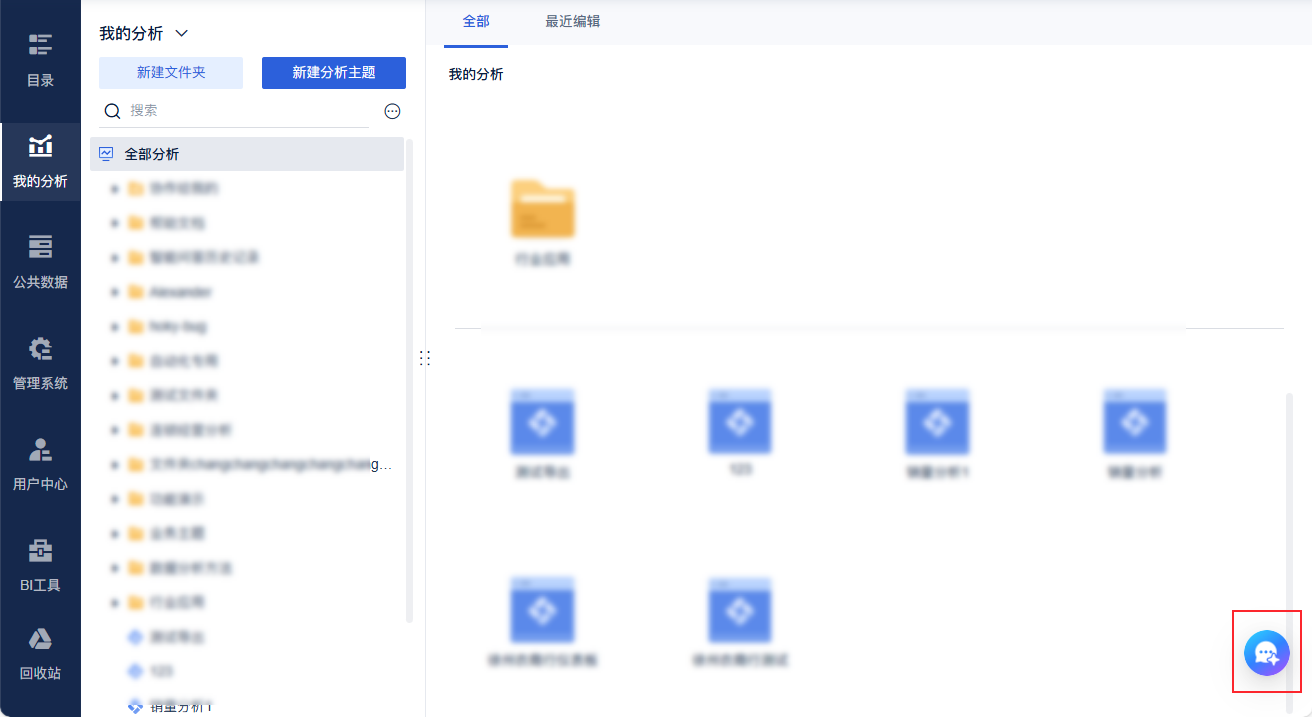

3)在管理系统右下角出现「问答BI」按钮即可完成,如下图所示: