最新历史版本

:华为GaussDB 200数据连接 返回文档

编辑时间:

内容长度:图片数:目录数:

修改原因:

1. 概述编辑

1.1 版本

| FineBI 版本 | 功能变动 |

|---|---|

| 6.0 | - |

1.2 应用场景

本文将介绍如何连接 GaussDB 200 数据库。

2. 准备工作编辑

2.1 版本和驱动

| 版本 | 驱动包下载 |

|---|---|

| gaussdb 200 |

2.2 收集连接信息

在连接数据库之前,请收集以下信息:

数据库所在服务器的 IP 地址和端口号;

数据库的名称;

数据库的用户名和密码;

需要连接的数据库模式;

3. 具体连接步骤编辑

1)以管理员身份登录 FineBI ,点击「管理系统>数据连接>数据连接管理>新建」,点击「数据连接」,如下图所示:

注:如果非管理员用户想要配置数据连接,需要管理员给其分配管理系统下数据连接节点的权限,具体操作请查看 数据连接权限

2)找到 GaussDB 200 的图标,如下图所示:

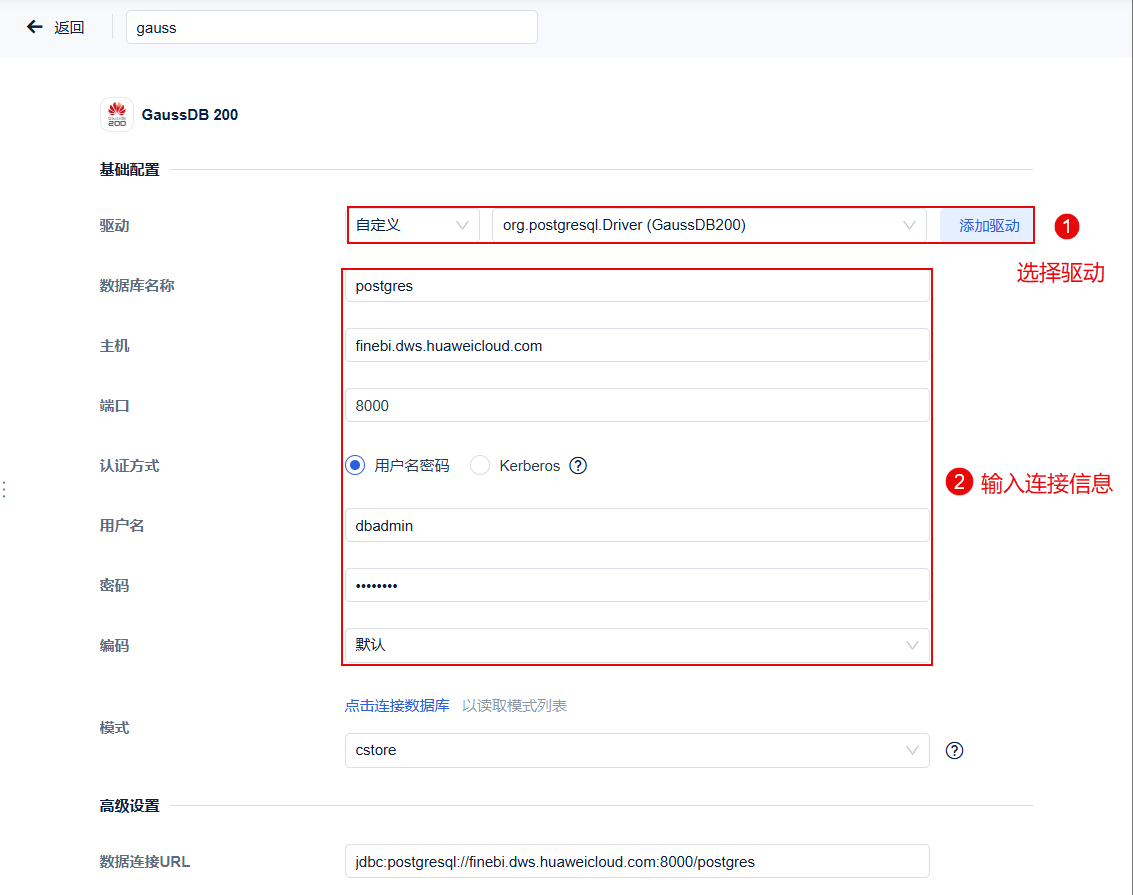

3)驱动切换为「自定义」选择 2.1 节上传的驱动,然后输入 2.2 节的连接信息。如下图所示:

注:用户可以选择性修改高级设置,详细请参见 配置数据连接 4.3 节

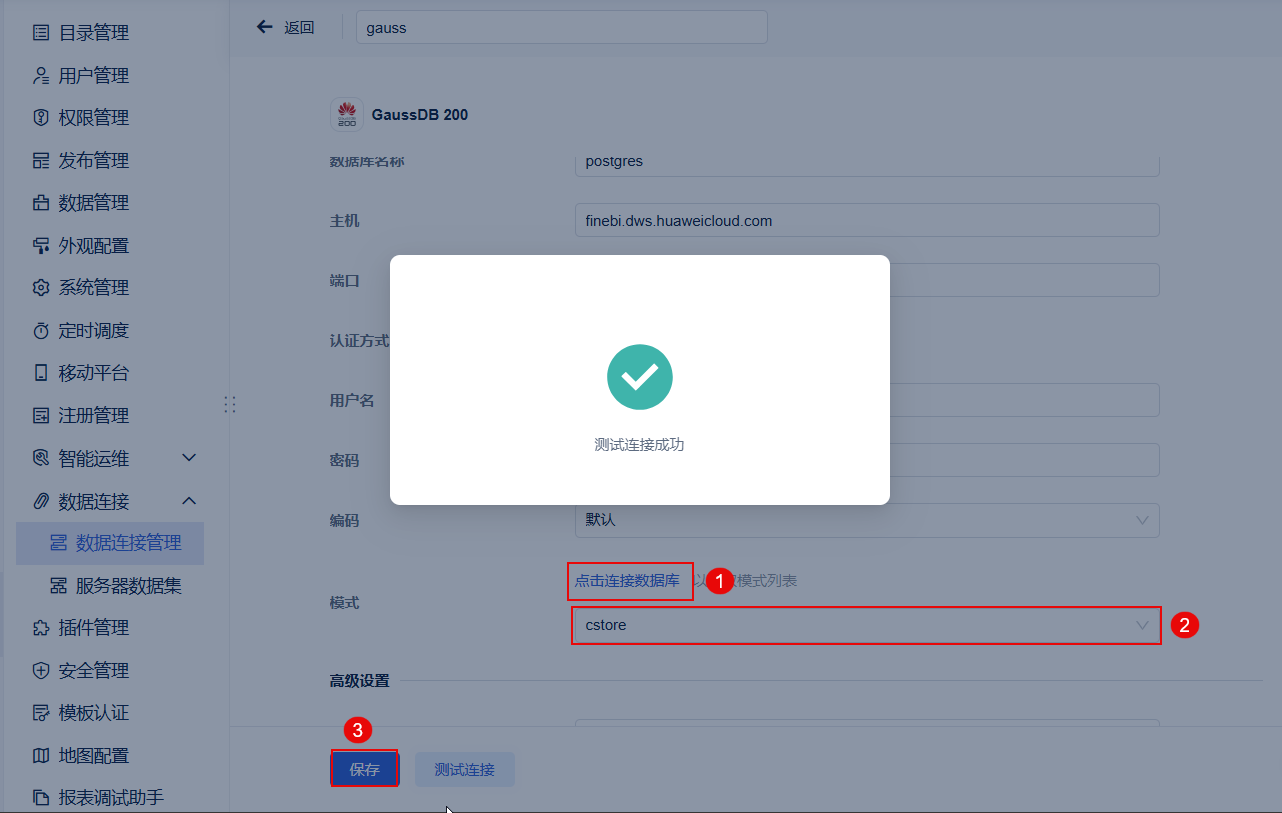

4)点击「连接数据库」,测试是否可以连接成功,若连接成功,用户可选择需要连接的模式,最后保存,如下图所示:

4. 添加数据库的表至 FineBI 编辑

5. 注意事项编辑

在使用 SQL 数据集添加到 BI 中时,SQL 语句中字段名不要加单引号,否则 BI 将错误调整字段名为"?column?";

在添加 SQL 数据集时,SQL 语句中若用到了order by 语句,则该SQL数据集的计算模式必须选择抽取数据来保存;