目录:

1. 概述编辑

本文对FineDataLink的特有概念进行解释说明,以便用户进行使用。

2. 功能模块名称编辑

包含数据开发、指标平台等功能,满足用户对数据进行同步、处理、清洗等一系列的需求。

| 名称 | 定位 | 功能说明 |

|---|---|---|

| 数据开发 | 数据定时同步和数据处理 | 通过 SQL 或者可视化的方式,完成任务的开发和编排 |

| 数据管道 | 数据实时同步 | 在数据库数据量大或表结构规范的情况下,实现高性能的实时数据同步。 |

| 任务运维 | 定时任务、管道任务 | 对任务进行集中管理和运行监控,提供任务的总览 |

3. 二级功能点说明编辑

3.1 步骤流

| 定位 | 功能界限 |

|---|---|

| 步骤流也叫工作流,工作流是对步骤进行编排,每个步骤都是相对独立的,只有执行的先后顺序区别,不会存在数据行的流动 | 步骤都要是闭环的,每一个步骤都是闭环:

|

步骤中涉及到的名称解释如下表所示:

| 归类 | 功能点 | 类型 | 定位 | 功能说明 | 起始版本 |

|---|---|---|---|---|---|

| 通用 | 数据同步 | 基础 | 快速完成数据同步(输入、输出),不支持在数据同步过程中做数据转换 | 支持多种类型的取数方式:API 取数、SQL 取数、文件取数等。由于无过程中的数据处理,所以不需要内存计算,适用于:

| 1.0 |

| 数据转换 | 高级 | 满足表输入和表输出之间需要做数据转换、处理的场景 | 在数据同步的基础上,支持在表输入和表输出之间做数据关联、数据转换、数据清洗等复杂数据处理和转换 本质上是数据流,由于过程中涉及到数据处理,需要依赖内存计算引擎,适用于小数据量(千万及以下)的数据开发,并且计算性能与内存配置有相关性 | 3.0 | |

| 脚本 | SQL 脚本 | 基础 | 将 SQL 语句发放到指定的关系型数据库上并执行 | 通过写 SQL 的形式,完成对表和数据的处理,例如:创建、更新、删除、读取、关联、汇总等操作时 | 1.0 |

| Shell 脚本 | 基础 | 使用远程SSH连接,调用远程环境里的可执行Shell脚本 | 通过使用配置好的远程SSH连接,可以选择调用远程环境里的可执行脚sh脚本。 | 4.0.8 | |

| 流程 | 条件分支 | 基础 | 用于在步骤流中进行条件判断 | 基于一个来自于上游或者系统的条件,判断是否继续运行下游的节点 | 2.0 |

| 调用任务 | 基础 | 调用其他任务,完成跨任务的编排 | 可以调用任意一个任务,被调用的任务被放到当前任务里编排 | 3.2 | |

| 虚拟节点 | 基础 | 空操作 | 虚拟节点即空操作,可以用于串联上下游都是多分支的场景,也可以用作流程设计 | 1.4 | |

| 循环容器 | 高级 | 满足多个节点循环执行的场景 | 提供一个循环容器,支持:遍历循环、条件循环 可以让容器内的节点进行循环执行 | 4.0.3.1 | |

| 参数赋值 | 基础 | 将获取的数据作参数输出 | 可以将读取的数据作为参数输出给下游节点使用 | ||

| 通知 | 消息通知 | 基础 | 自定义通知内容和通知渠道 | 通知渠道:邮件通知、短信通知、平台通知、企业微信通知(群机器人、应用通知)、钉钉通知 通知内容:可自定义 | V3.6 V4.0.1 V4.0.3 |

| 连线 | 节点连线执行判断 | 基础 | 对上下游执行逻辑进行设置 | 在 步骤流 中,右键点击节点连线,提供「无条件执行」、「成功时执行」、「报错时执行」的节点连线配置 在 步骤流 中,右键点击节点,新增「执行判断」按钮,支持自定义多执行条件的生效方式(全部逻辑与、全部逻辑或),灵活控制任务中节点的依赖关系 | 4.0.3 |

| 其他 | 备注说明 | 基础 | 在画布中为任务添加备注 | 自定义内容、自定义格式。 | 4.0.4 |

3.2 数据流

| 定位 | 功能界限 |

|---|---|

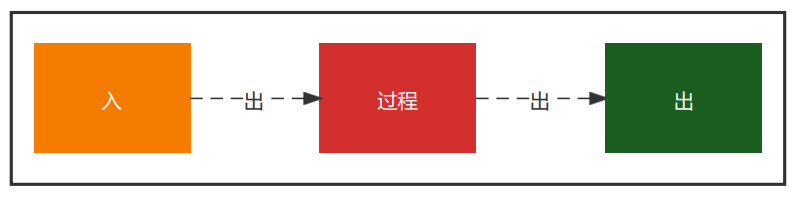

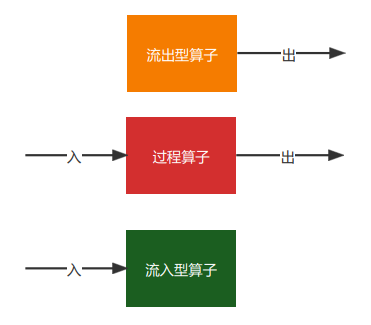

| 从输入控件(Input)到输出控件(Output)之间的数据流动,针对的是在数据流动过程中的每一行记录、每一列数据的处理。数据流里提供了各类算子,可以完成数据的输入、输出、转换等操作 | 数据流里只提供以下三类算子,不应该包含组合型、流程类的算子:

|

数据流中涉及到的名称解释如下表所示:

| 归类 | 功能点 | 类型 | 定位 | 功能说明 | 起始版本 |

|---|---|---|---|---|---|

| 输入 | DB表输入 | 基础 | 读取数据库表的数据 | - | 3.0 |

| API输入 | 基础 | 通过API读取数据 | - | 3.0 | |

| 数据集输入 | 基础 | 读取服务器数据集或者自助数据集里的数据 | - | 3.0 | |

| 简道云输入 | 基础 | 满足简道云数据下云进行备份、计算、分析和展示的需求 | 实现获取指定简道云表单数据的功能 | 4.0.2 | |

| MongoDB输入 | 基础 | 满足接入 MongoDB 数据源进行数据处理的需求 | - | 4.0.4.1 | |

| SAP 输入 | 基础 | 通过 RFC 接口调用 SAP 系统内已经开发好的函数,并将数据取出。 | - | 4.0.10 | |

| 文件输入 | 基础 | 读取指定来源与路径的结构化文件数据。 | 实现读取指定来源与路径的结构化文件获取数据的功能。 | 4.0.14 | |

| 输出 | DB表输出 | 基础 | 将数据输出到数据库表 | - | 3.0 |

| 比对删除 | 基础 | 将来源表中「数据删除」这一变化同步至目标表 | 通过字段值对比,对目标表中存在,但是输入源中不存在的数据行进行删除。包含:

| 3.2 | |

| 参数输出 | 基础 | 将取到的数据输出为参数,供下游节点使用 | 将数据作为参数输出,供任务内下游节点使用 | 4.0.13 | |

| 连接 | 数据关联 | 高级 | 用于将多个输入进行连接,并输出连接后的结果 支持跨库、跨源的连接 | 连接方式主要有以下几种:

这些连接方式与数据库里表连接的方式一致,通过确定关联字段和关联条件,最后得到匹配连接后的结果集。连接的输入是两个以上,输出只有一个 | 3.1 |

| 转换 | 字段设置 | 高级 | 满足字段名称、类型调整的需求 | 提供以下功能:

| 3.7 |

| 行列转换 | 高级 | 实现数据表行列结构的改变,满足一维表和二维表之间转换的需求 | 对输入的数据表进行列转行操作:

| 3.5 | |

| JSON解析 | 基础 | 用于解析 JSON 结构的数据,输出行列格式的数据 | 通过获取上游输出的 JSON 数据,按照 JSONPath 的规范将其自定义解析成需要的字段并输出给下游 | 3.5 | |

| XML解析 | 基础 | 支持指定解析策略,将输入的XML数据解析为行列形式的数据 | 支持指定解析策略,将输入的XML数据解析为行列形式的数据。 | 4.0.9 | |

| 实验室 | Spark SQL | 高级 | 核心作用是通过提供灵活的Spark SQL,提高场景覆盖率 | 内置的有Spark 计算引擎,通过提供Spark SQL算子,用户可以: 获取上游输出的数据,使用Spark SQL对其进行查询和处理,并输出给下游 | 3.6 |