历史版本37 :数据转换概述 返回文档

编辑时间:

内容长度:图片数:目录数:

修改原因:

1. 概述编辑

[helpvideo]5448[/helpvideo]

1.1 版本说明

| FineDataLink 版本 | 功能变动 |

|---|---|

| 3.1 | 新增节点「数据转换」,可实现数据跨库关联 |

| 4.0.23 | 新增「新增计算列」算子,可利用原有字段通过引用或计算获得一个新的字段 |

| 查看历史版本更新 | ||||||||||||||||||||||||||||

|

1.2 应用场景

数据同步节点 支持将数据进行跨数据库的同步,但是如果用户希望将数据进行比较复杂的处理(数据JSON 解析、SQL语句等)后在同步至数据库中,则需要使用数据转换功能,取数后进行数据处理在进行数据同步,如下图所示:

注:若用户希望将大量的数据直接抽取同步写入数据库中,且想要同步的数据不需要非常复杂的处理步骤,则可以使用 数据同步节点

1.3 功能简介

「数据转换」提供输入、输出、转换等类型的节点,可在抽数过程中实现复杂的数据转换。

注:数据转换和数据同步的区别详情参见:数据同步与数据转换的区别

2. 功能列表编辑

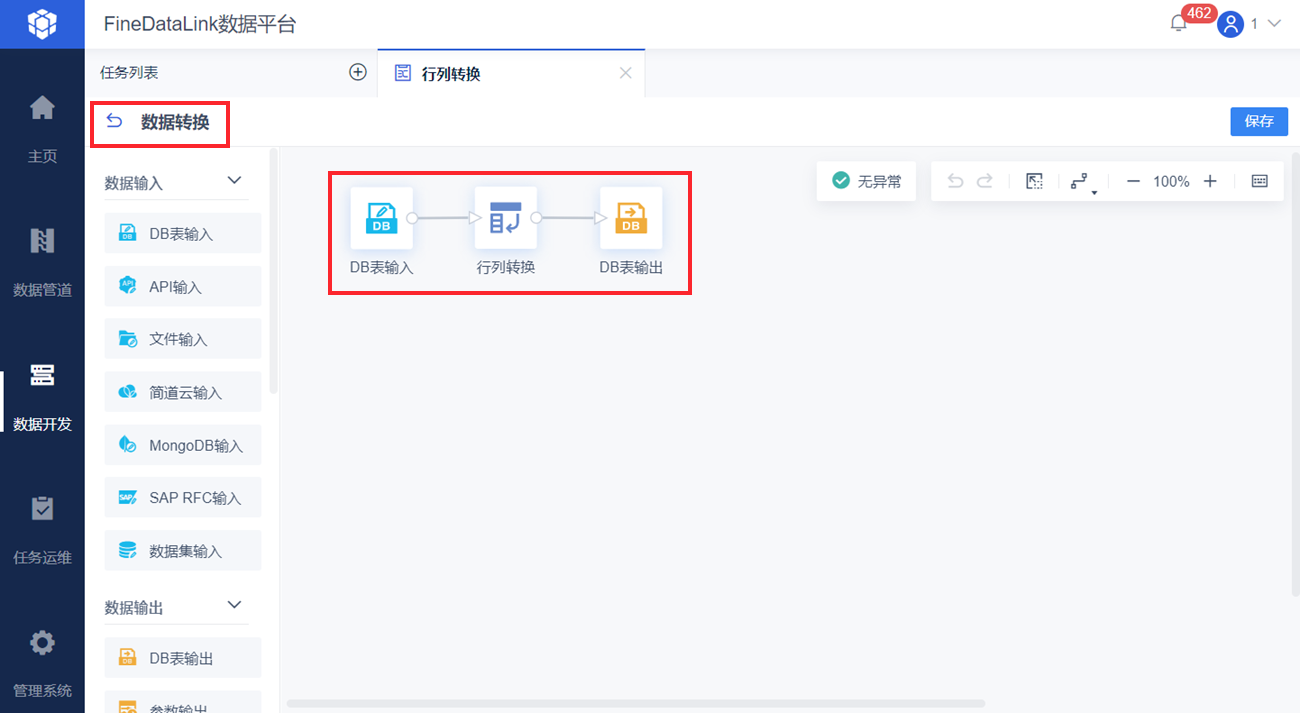

节点拖到设计界面后,点击该节点打开编辑界面,可以看到「数据转换」节点的设置是拖动节点和连线的形式。

界面如下图所示:

可以把「数据转换」节点设置界面的那些节点称为算子,这些算子的类型有:

| 功能列表 | 说明 |

|---|---|

| 数据输入 | 需要同步的来源数据:可以是数据库数据、API、数据集数据、简道云数据、MongoDB数据库数据、SAP RFC输入、文件输入 |

| 连接 | 将多个数据表进行 JOIN 操作,详情请参见:数据关联、数据比对 |

| 转换 | 对数据字段进行转换处理 |

| 实验室 | Spark SQL 算子使用户可以在提供的数据流算子不丰富的情况下,通过 SQL 语句依然能够实现比较灵活的数据转换功能。详情请参见:Spark SQL算子 |

| 其他 | 备注说明 详情参见ETL任务和节点添加备注 第 2.2 节。 |

| 数据输出 | 「数据转换」节点中,用户可根据业务需要,对不同字段给予加工处理后再流向不同表。详情请参见:数据分发 DB 表输出:将处理好的数据输出到目标数据库中,可参见:DB 表输出 参数输出:将取到的数据输出为参数,供下游节点使用 参数输出 API输出:将处理好的数据以 API 形式输出到 API 接口中,可参见:API输出 简道云输出:将处理好的数据输出到简道云指定表单中,可参见:简道云输出 |